Mit der rasanten Entwicklung der Robotik und künstlichen Intelligenz stehen wir vor grundlegenden ethischen Herausforderungen. Während Roboter immer autonomer, intelligenter und präsenter in unserem Leben werden, müssen wir uns mit den moralischen Implikationen dieser Technologien auseinandersetzen. Dieser Artikel untersucht die wichtigsten ethischen Fragen im Bereich der Robotik und wie wir als Gesellschaft darauf reagieren sollten.

Die Grundfragen der Roboterethik

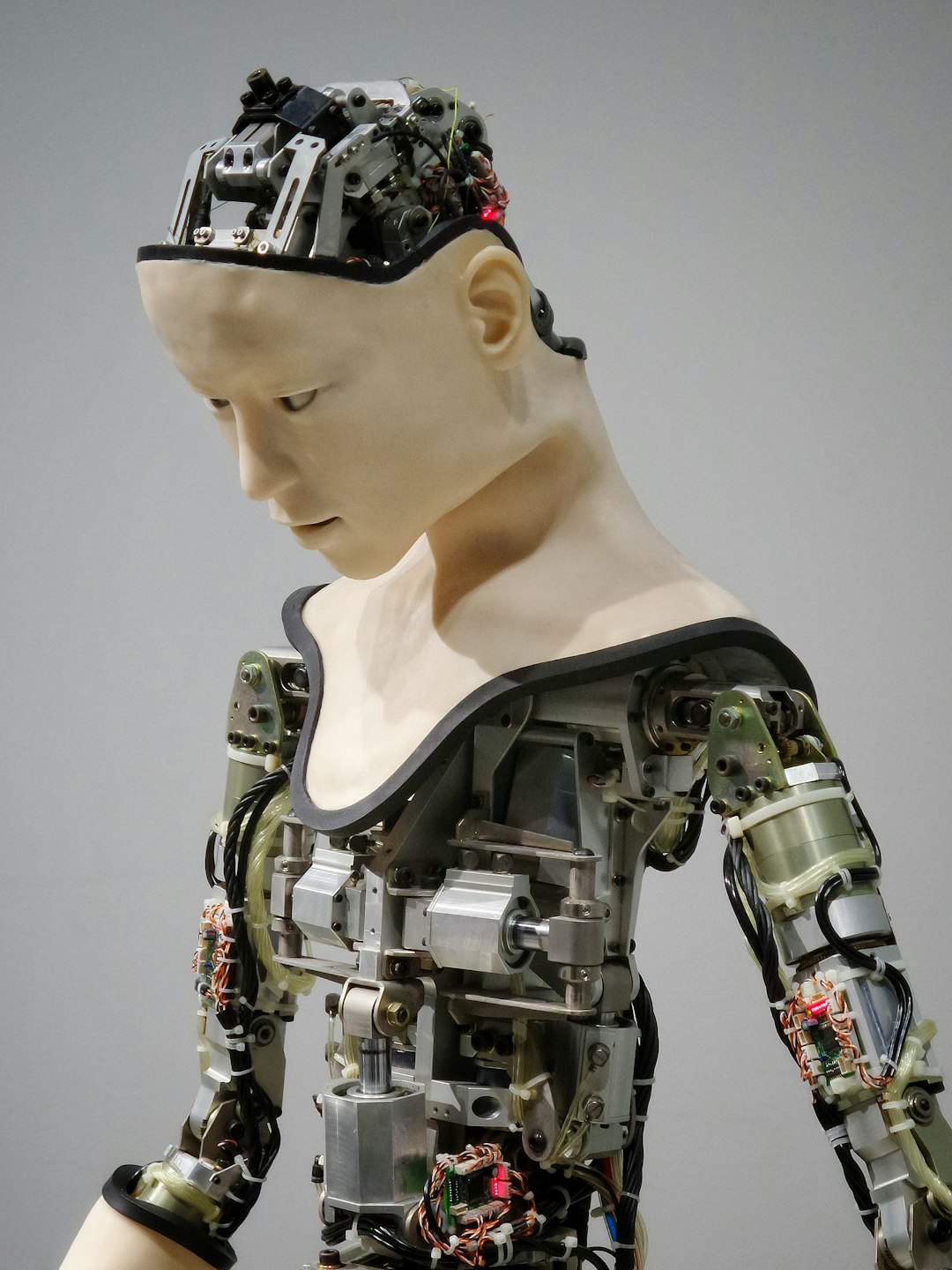

Die Ethik der Robotik befasst sich mit zwei grundlegenden Fragestellungen: Wie sollten Menschen Roboter behandeln, und wie sollten Roboter programmiert werden, um mit Menschen und der Umwelt zu interagieren? Diese Fragen werden umso dringlicher, je autonomer und menschenähnlicher Roboter werden.

Die ethischen Herausforderungen der Robotik sind nicht nur technischer, sondern auch philosophischer, juristischer und gesellschaftlicher Natur. Sie berühren grundlegende Konzepte wie Verantwortung, Autonomie, Würde, Gerechtigkeit und letztlich auch unser Menschenbild.

"Die Frage ist nicht, ob Roboter ethische Entscheidungen treffen können, sondern welche ethischen Prinzipien wir in ihre Entscheidungsfindung einbauen sollten." - Prof. Dr. Michael Bauer, Institut für Technikethik

Verantwortung und Haftung

Eine der zentralen Fragen betrifft die Verantwortung: Wer trägt die Verantwortung, wenn ein autonomer Roboter einen Schaden verursacht? Der Hersteller, der Programmierer, der Besitzer oder der Roboter selbst?

Je autonomer Roboter werden, desto schwieriger wird es, die Verantwortungskette nachzuvollziehen. Wenn ein selbstlernendes System auf Basis seiner Erfahrungen Entscheidungen trifft, die nicht direkt vorhersehbar waren, verschwimmen die traditionellen Grenzen der Haftung.

Die Programmierung ethischer Entscheidungen in autonome Systeme stellt Entwickler vor komplexe Herausforderungen

Rechtssysteme weltweit beginnen, diese Herausforderung anzugehen. Die Europäische Union hat beispielsweise Vorschläge für einen rechtlichen Rahmen für KI und Robotik entwickelt, der eine Art "elektronische Person" als Rechtskategorie einführen könnte. Dies würde es ermöglichen, autonome Systeme direkt haftbar zu machen, ähnlich wie bei Unternehmen.

Autonomie und Entscheidungsfindung

Das Trolley-Problem in der Robotik

Ein klassisches ethisches Dilemma, das in der Robotik besondere Relevanz erlangt hat, ist das "Trolley-Problem": Eine führerlose Straßenbahn rast auf fünf Menschen zu. Durch Umstellen einer Weiche könnte man die Bahn auf ein anderes Gleis lenken, wo nur ein Mensch steht. Ist es moralisch vertretbar, aktiv einzugreifen und damit den Tod einer Person zu verursachen, um fünf andere zu retten?

Dieses Gedankenexperiment wird sehr real, wenn wir über selbstfahrende Autos nachdenken. Wie soll ein autonomes Fahrzeug in einer unvermeidbaren Unfallsituation entscheiden? Soll es das Leben der Passagiere über das von Fußgängern stellen? Wie soll es unterschiedliche Risiken abwägen?

Ethische Algorithmen

Die Herausforderung besteht darin, ethische Prinzipien in Algorithmen zu übersetzen. Verschiedene Ansätze werden erforscht:

- Regelbasierte Ethik: Klare Verhaltensregeln werden vordefiniert (z.B. "Vermeide Schaden an Menschen").

- Konsequentialistische Ansätze: Der Roboter bewertet die möglichen Folgen verschiedener Handlungsoptionen und wählt die mit dem besten Gesamtergebnis.

- Tugendethik: Der Roboter wird darauf trainiert, bestimmte "Tugenden" wie Fürsorge oder Gerechtigkeit in seinen Entscheidungen zu berücksichtigen.

- Hybride Modelle: Kombinationen verschiedener ethischer Frameworks, die situationsabhängig angewendet werden.

Privatsphäre und Überwachung

Roboter, insbesondere in häuslichen Umgebungen, sammeln eine enorme Menge an Daten über unsere Gewohnheiten, Vorlieben und Verhaltensweisen. Diese Daten ermöglichen es ihnen, bessere Dienste zu leisten, werfen aber auch ernsthafte Fragen zur Privatsphäre auf.

Ein Haushaltsroboter kennt potentiell intime Details über unseren Lebensstil – wann wir aufstehen, was wir essen, welche Gespräche wir führen. Die Gefahr des Missbrauchs dieser Daten durch Hersteller, Drittanbieter oder durch Hackerangriffe ist erheblich.

Gleichzeitig könnten Überwachungsroboter in öffentlichen Räumen zu einer dystopischen Gesellschaft führen, in der jede Bewegung aufgezeichnet und analysiert wird. Die Balance zwischen Sicherheit und Freiheit muss sorgfältig austariert werden.

Menschliche Würde und emotionale Bindung

Roboter werden zunehmend in Bereichen eingesetzt, die traditionell zwischenmenschlichen Kontakt erforderten, wie Pflege, Bildung und Therapie. Dies wirft Fragen nach der menschlichen Würde und dem Wert authentischer zwischenmenschlicher Beziehungen auf.

In der Altenpflege können Roboter praktische Unterstützung bieten und Einsamkeit lindern. Gleichzeitig besteht die Gefahr, dass sie als billiger Ersatz für menschliche Zuwendung missbraucht werden. Ähnlich könnten Therapieroboter für Kinder mit Autismus wertvolle Dienste leisten, aber niemals die Tiefe und Authentizität menschlicher Beziehungen ersetzen.

Besonders problematisch wird es, wenn Roboter darauf ausgelegt sind, emotionale Bindungen zu erzeugen. Soziale Roboter wie der Therapieroboter PARO sind bewusst so gestaltet, dass Menschen emotionale Bindungen zu ihnen aufbauen. Dies kann therapeutisch wertvoll sein, wirft aber auch die Frage auf, ob solche "künstlichen" Beziehungen das menschliche Bedürfnis nach echtem Kontakt untergraben.

Soziale und wirtschaftliche Gerechtigkeit

Arbeitsplätze und wirtschaftliche Disruption

Die zunehmende Automatisierung durch Roboter und KI wird zweifellos viele traditionelle Arbeitsplätze verändern oder überflüssig machen. Während einige argumentieren, dass wie bei früheren technologischen Revolutionen neue Arbeitsplätze entstehen werden, besteht die Sorge, dass diesmal das Ausmaß und Tempo der Veränderung beispiellos sein könnten.

Die ethische Herausforderung besteht darin, einen gerechten Übergang zu gestalten. Wie können wir sicherstellen, dass die Vorteile der Robotik allen zugutekommen und nicht nur einer privilegierten Minderheit? Konzepte wie ein bedingungsloses Grundeinkommen, Robotersteuern oder drastisch verkürzte Arbeitszeiten werden als mögliche Antworten diskutiert.

Globale Gerechtigkeit und Zugang

Die Gefahr besteht, dass fortschrittliche Robotertechnologie primär wohlhabenden Ländern und Bevölkerungsgruppen zur Verfügung steht, was bestehende globale Ungleichheiten verstärken könnte. Gleichzeitig bietet Robotik Chancen für Entwicklungsländer, etwa durch Telemedizin-Roboter, die hochwertige medizinische Versorgung in abgelegene Gebiete bringen können.

Roboterrechte: Eine Zukunftsfrage?

Eine derzeit noch theoretische, aber zunehmend diskutierte Frage betrifft mögliche "Rechte" für hochentwickelte Roboter. Wenn Roboter in Zukunft ein Bewusstsein oder eine Form von Subjektivität entwickeln sollten, könnten ethische und rechtliche Schutzmaßnahmen erforderlich werden.

Während wir von echter künstlicher Intelligenz, die mit menschlichem Bewusstsein vergleichbar wäre, noch weit entfernt sind, ist es wichtig, diese Fragen vorausschauend zu diskutieren. Die Geschichte zeigt, dass wir oft zu spät reagieren, wenn es um die ethischen Implikationen neuer Technologien geht.

Lösungsansätze: Ethische Richtlinien und Regulierung

Weltweit arbeiten Regierungen, Organisationen und Forschungseinrichtungen an ethischen Rahmenwerken für die Robotik. Beispiele hierfür sind:

- Asimovs Robotergesetze: Die 1942 vom Science-Fiction-Autor Isaac Asimov formulierten Gesetze (ein Roboter darf keinem Menschen schaden, muss Befehlen gehorchen und sich selbst schützen) dienen oft als Ausgangspunkt für ethische Diskussionen.

- IEEE Global Initiative: Die "Ethically Aligned Design" Initiative des IEEE entwickelt praktische Standards für ethische KI und Robotik.

- EU-Richtlinien: Die Europäische Union arbeitet an einem umfassenden regulatorischen Rahmen für KI und Robotik, der ethische Grundsätze wie Transparenz, Nichtdiskriminierung und Verantwortlichkeit festschreibt.

- Nationale Strategien: Länder wie Japan, Südkorea und Deutschland haben nationale Strategien entwickelt, die ethische Aspekte der Robotik adressieren.

Wichtige Prinzipien, die in diesen Rahmenwerken häufig auftauchen, sind:

- Transparenz: Die Funktionsweise von Robotern sollte nachvollziehbar und erklärbar sein.

- Verantwortlichkeit: Klare Zuordnung von Verantwortung für Roboterhandlungen.

- Nichtdiskriminierung: Roboter sollten frei von Vorurteilen und Diskriminierung agieren.

- Sicherheit: Der Schutz von Menschen hat höchste Priorität.

- Privatsphäre: Respekt für persönliche Daten und private Räume.

- Menschenzentriertheit: Roboter sollten menschliche Autonomie und Würde fördern, nicht untergraben.

Fazit: Ein gesellschaftlicher Dialog ist notwendig

Die ethischen Fragen der Robotik können nicht allein von Ingenieuren, Ethikern oder Politikern beantwortet werden. Sie erfordern einen breiten gesellschaftlichen Dialog, der verschiedene Perspektiven, Werte und Interessen berücksichtigt.

Wir stehen an einem kritischen Punkt in der Entwicklung der Robotik. Die Entscheidungen, die wir heute treffen, werden die Zukunft dieser Technologie prägen und bestimmen, ob sie zum Wohle der Menschheit eingesetzt wird oder nicht.

Die Robotik bietet enorme Chancen, um globale Herausforderungen wie Klimawandel, Gesundheitsversorgung und nachhaltige Entwicklung anzugehen. Gleichzeitig birgt sie erhebliche Risiken. Eine vorausschauende, reflektierte und inklusive Herangehensweise an die Ethik der Robotik ist daher unerlässlich, um sicherzustellen, dass diese mächtige Technologie im Dienste der Menschheit steht.